Mit zunehmender Leistungsfähigkeit eröffneten sich neue Einsatzbereiche. Computer sind heute in allen Bereichen des täglichen Lebens vorzufinden. Beispielsweise dienen integrierte Kleinstcomputer (

eingebettetes System) zur

Steuerung von Waschmaschinen und weiteren Geräten des Alltags vom

Telefon über den

Videorekorder bis hin zur Münzprüfung in Warenautomaten;

Personal Computer dienen der Verarbeitung und Ausgabe von Informationen in Wirtschaft und Behörden, der Berechnung der Statik von Bauwerken;

Supercomputer werden eingesetzt, um komplexe Vorgänge zu

simulierenin der Klimaforschung oder für thermodynamische Fragestellungen und medizinische Berechnungen.

Herkunft des Namens

Der englische Begriff

computer, abgeleitet vom Verb (

to)

compute (zu

Lateinisch:

computare = „zusammenrechnen“), bezeichnete ursprünglich Menschen, die zumeist langwierige Berechnungen vornahmen, zum Beispiel für Astronomen im Mittelalter. 1938 stellte

Konrad Zuse den ersten frei programmierbaren mechanischen

Rechner her, der im heutigen Sinne bereits dem Begriff entsprach. In der Namensgebung des 1946 der Öffentlichkeit vorgestellten

Electronic Numerical Integrator and Computer (kurz ENIAC) taucht erstmals das Wort als Namensbestandteil auf. In der Folge etablierte sich

Computer als Gattungsbegriff für diese neuartigen Maschinen.

Grundlagen

Grundsätzlich unterscheiden sich zwei Bauweisen: Ein Computer ist ein

Digitalcomputer, wenn er mit

digitalen Geräteeinheiten digitale Daten verarbeitet; er ist ein

Analogcomputer, wenn er mit

analogen Geräteeinheiten analoge Daten verarbeitet.

Heute werden fast ausschließlich Digitalcomputer eingesetzt. Diese folgen gemeinsamen Grundprinzipien, mit denen ihre freie Programmierung ermöglicht wird. Bei einem Digitalcomputer werden dabei zwei grundsätzliche Bausteine unterschieden: Die

Hardware, die aus den elektronischen, physisch anfassbaren Teilen des Computers gebildet wird, sowie die

Software, die die

Programmierung des Computers beschreibt.

Ein Digitalcomputer besteht zunächst nur aus Hardware. Die Hardware stellt erstens einen so genannten

Speicher bereit, in dem

Daten wie in Schubladen gespeichert und jederzeit zur Verarbeitung bzw. Ausgabe abgerufen werden können. Zweitens verfügt das Rechenwerk der Hardware über grundlegende Bausteine für eine freie Programmierung, mit denen jede beliebige Verarbeitungslogik für Daten dargestellt werden kann: Diese Bausteine sind im Prinzip die

Berechnung, der

Vergleich und der

bedingte Sprung. Ein Digitalcomputer kann beispielsweise zwei Zahlen addieren, das Ergebnis mit einer dritten Zahl vergleichen und dann abhängig vom Ergebnis entweder an der einen oder der anderen Stelle des Programms fortfahren. In der

Informatik wird dieses Modell theoretisch durch die

Turing-Maschine abgebildet; die Turing-Maschine stellt die grundsätzlichen Überlegungen zur

Berechenbarkeit dar.

Erst durch eine Software wird der Digitalcomputer jedoch nützlich. Jede

Software ist im Prinzip eine definierte, funktionale Anordnung der oben geschilderten Bausteine Berechnung, Vergleich und Bedingter Sprung, wobei die Bausteine beliebig oft verwendet werden können. Diese Anordnung der Bausteine, die als

Programm bezeichnet wird, wird in Form von Daten im Speicher des Computers abgelegt. Von dort kann sie von der Hardware ausgelesen und abgearbeitet werden. Dieses Funktionsprinzip der Digitalcomputer hat sich seit seinen Ursprüngen in der Mitte des 20. Jahrhunderts nicht wesentlich verändert, wenngleich die Details der Technologie erheblich verbessert wurden.

Analogrechner funktionieren jedoch nach einem anderen Prinzip. Bei ihnen ersetzen analoge Bauelemente (

Verstärker,

Kondensatoren) die Logikprogrammierung. Analogrechner wurden früher häufiger zur Simulation von Regelvorgängen eingesetzt (siehe:

Regelungstechnik), sind heute aber fast vollständig von

Digitalcomputern verdrängt worden. In einer Übergangszeit gab es auch

Hybridrechner, die einen Analog- mit einem digitalen Computer kombinierten.

Hardwarearchitektur

In den heutigen Computern sind die ALU und die Steuereinheit meistens zu einem Baustein verschmolzen, der so genannten

CPU (Central Processing Unit, zentraler

Prozessor).

Der Speicher ist eine Anzahl von durchnummerierten „Zellen“; jede von ihnen kann ein kleines Stück Information aufnehmen. Diese Information wird als

Binärzahl, also einer Abfolge von ja/nein-Informationen, in der Speicherzelle abgelegt – besser vorzustellen als eine Folge von Nullen und Einsen. Ein Charakteristikum der „Von Neumann-Architektur“ ist, dass diese Binärzahl (bspw.:

01000001, was der Dezimalzahl

65 entspricht) entweder ein Teil der Daten (also z. B. der Buchstabe „A“) oder ein

Befehl für die CPU („Springe …“) sein kann.

Wesentlich in der Von-Neumann-Architektur ist, dass sich Programm und Daten einen Speicherbereich teilen (dabei belegen die Daten in aller Regel den unteren und die Programme den oberen Speicherbereich).

Dem gegenüber stehen in der sog.

Harvard-Architektur Daten und Programmen eigene (physikalisch getrennte) Speicherbereiche zur Verfügung, dadurch können Daten-Schreiboperationen keine Programme überschreiben.

In der Von-Neumann-Architektur ist die Steuereinheit dafür zuständig, zu wissen, was sich an welcher Stelle im Speicher befindet. Man kann sich das so vorstellen, dass die Steuereinheit einen „Zeiger“ auf eine bestimmte Speicherzelle hat, in der der nächste Befehl steht, den sie auszuführen hat. Sie liest diesen aus dem Speicher aus, erkennt zum Beispiel „65“, erkennt dies als „Springe“. Dann geht sie zur nächsten Speicherzelle, weil sie wissen muss, wohin sie springen soll. Sie liest auch diesen Wert aus und interpretiert die Zahl als Nummer (so genannte Adresse) einer Speicherzelle. Dann setzt sie den Zeiger auf eben diese Speicherzelle, um dort wiederum ihren nächsten Befehl auszulesen; der Sprung ist vollzogen. Wenn der Befehl zum Beispiel statt „Springe“ lauten würde „Lies Wert“, dann würde sie nicht den Programmzeiger verändern, sondern aus der in der Folge angegebenen Adresse einfach den Inhalt auslesen, um ihn dann beispielsweise an die ALU weiterzuleiten.

Die ALU hat die Aufgabe, Werte aus Speicherzellen zu kombinieren. Sie bekommt die Werte von der Steuereinheit geliefert, verrechnet sie (addiert beispielsweise zwei Zahlen, welche die Steuereinheit aus zwei Speicherzellen ausgelesen hat) und gibt den Wert an die Steuereinheit zurück, die den Wert dann für einen Vergleich verwenden oder wieder in eine dritte Speicherzelle zurückschreiben kann.

Die Ein-/Ausgabeeinheiten schließlich sind dafür zuständig, die initialen Programme in die Speicherzellen einzugeben und dem Benutzer die Ergebnisse der Berechnung anzuzeigen.

Softwarearchitektur

Die

Von-Neumann-Architektur ist gewissermaßen die unterste Ebene des Funktionsprinzips eines Computers oberhalb der elektrophysikalischen Vorgänge in den Leiterbahnen. Die ersten Computer wurden auch tatsächlich so programmiert, dass man die Nummern von Befehlen und von bestimmten Speicherzellen so, wie es das Programm erforderte, nacheinander in die einzelnen Speicherzellen schrieb. Um diesen Aufwand zu reduzieren, wurden

Programmiersprachen entwickelt. Diese generieren die Zahlen innerhalb der Speicherzellen, die der Computer letztlich als Programm abarbeitet, aus höheren Strukturen heraus automatisch.

Später wurden bestimmte sich wiederholende Prozeduren in so genannten

Bibliotheken zusammengefasst, um nicht jedes Mal das Rad neu erfinden zu müssen, z. B.: das Interpretieren einer gedrückten Tastaturtaste als Buchstabe „A“ und damit als Zahl „65“ (im

ASCII-Code). Die Bibliotheken wurden in übergeordneten Bibliotheken gebündelt, welche Unterfunktionen zu komplexen Operationen verknüpfen (Beispiel: die Anzeige eines Buchstabens „A“, bestehend aus 20 einzelnen schwarzen und 50 einzelnen weißen Punkten auf dem Bildschirm, nachdem der Benutzer die Taste „A“ gedrückt hat).

In einem modernen Computer arbeiten sehr viele dieser Programmebenen über- bzw. untereinander. Komplexere Aufgaben werden in Unteraufgaben zerlegt, die von anderen Programmierern bereits bearbeitet wurden, die wiederum auf die Vorarbeit weiterer Programmierer aufbauen, deren Bibliotheken sie verwenden. Auf der untersten Ebene findet sich aber immer der so genannte

Maschinencode – jene Abfolge von Zahlen, mit der der Computer auch tatsächlich gesteuert wird.

Während früher eine

CPU nur mit diesem Maschinencode gesteuert werden konnte, sind inzwischen auch CPUs programmierbar und damit kleine eigenständige Computer.

Geschichte

Die Vorläufer des modernen Computers

Die Computertechnologie entwickelte sich im Vergleich zu anderen Elektrogeräten sehr schnell. Die Geschichte der Entwicklung des Computers reicht zurück bis in die Antike und ist damit wesentlich länger als die Geschichte der modernen Computertechnologien und mechanischen rsp. elektrischen Hilfsmitteln (Rechenmaschinen oder

Hardware). Sie umfasst dabei auch die Entwicklung von Rechenmethoden, die etwa für einfache Schreibgeräte auf Papier und Tafeln entwickelt wurden. Im Folgenden wird entsprechend versucht, einen Überblick über diese Entwicklungen zu geben.

Zahlen als Grundlage der Computergeschichte

Das Konzept der

Zahlen lässt sich auf keine konkreten Wurzeln zurückführen und hat sich wahrscheinlich mit den ersten Notwendigkeiten der

Kommunikation zwischen zwei Individuen entwickelt. Man findet in allen bekannten

Sprachen mindestens für die Zahlen

eins und

zwei Entsprechungen. Auch in der Kommunikation von vielen Tierarten (etwa verschiedener

Primaten, aber auch Vögeln wie der

Amsel) lässt sich die Möglichkeit der Unterscheidung unterschiedlicher Mengen von Gegenständen feststellen.

Im Mittelalter erreichte das

Arabische Zahlensystem Europa und erlaubte eine größere Systematisierung bei der Arbeit mit Zahlen. Die Möglichkeiten erlaubten die Darstellung von Zahlen, Ausdrücke und Formeln auf

Papier und die Tabellierung von mathematischen Funktionen wie etwa der Quadratwurzeln rsp. des einfachen

Logarithmus sowie der

Trigonometrie. Zur Zeit der Arbeiten von

Isaac Newton war

Papier und

Velin eine bedeutende Ressource für Rechenaufgaben und ist dies bis in die heutige Zeit geblieben, in der Forscher wie

Enrico Fermi seitenweise Papier mit mathematischen Berechnungen füllten und

Richard Feynman jeden mathematischen Schritt mit der Hand bis zur Lösung berechnete, obwohl es zu seiner Zeit bereits programmierbare Rechner gab.

Frühe Entwicklung von Rechenmaschinen und -hilfsmitteln

Die Entwicklung mechanischer Rechenhilfen

Eine nicht ausbalancierte Waage

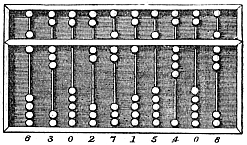

Das früheste Gerät, das in rudimentären Ansätzen mit einem heutigen Computer vergleichbar ist, ist der

Abakus, eine mechanische Rechenhilfe, die vermutlich um 1100 v. Chr. im indochinesischen Kulturraum erfunden wurde. Der Abakus wurde bis ins 17. Jahrhundert benutzt und dann von den ersten

Rechenmaschinen ersetzt. In ärmeren Regionen der Welt wird der Abakus noch immer als Rechenhilfe verwendet. Einem ähnlichen Zweck diente auch das Rechenbrett des

Pythagoras. Ebenfalls zu den frühen Rechenmaschinen gehört die

Balkenwaage, die allerdings keinen numerischen Ansatz bietet sondern mit deren Hilfe versucht werden soll, beidseitig einer gemeinsamen Aufhängung eine Gleichheit des Gewichtes zu erreichen.

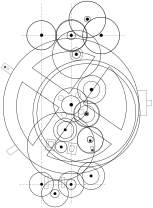

Bereits im 1. Jh. v. Chr. wurde mit dem

Computer von Antikythera die erste Rechenmaschine erfunden. Das Gerät diente vermutlich für astronomische Berechnungen und funktionierte mit einem

Differentialgetriebe, einer erst im 13. Jahrhundert wiederentdeckten Technik.

Mit dem Untergang der Antike kam der technische Fortschritt zum Stillstand und in den Zeiten der Völkerwanderung ging viel Wissen verloren (so beispielsweise auch der Computer von Antikythera, der erst 1902 wiederentdeckt wurde). Das Mittelalter schließlich hemmte den technischen Fortschritt. Doch ab der

Neuzeit begann sich der Motor des technischen Fortschritts wieder langsam zu drehen und beschleunigte fortan – und dies tut er bis heute.

1614 publizierte

John Napier seine

Logarithmentafel und 1623 baute

Wilhelm Schickard die erste

Vier-Spezies-Maschine und damit den ersten mechanischen Rechner der Neuzeit, wodurch er bis heute zum „Vater der Computerära“ wurde. Seine Konstruktion basierte auf dem Zusammenspiel von

Zahnrädern, die im Wesentlichen aus dem Bereich der

Uhrmacherkunst stammten und dort genutzt wurden, wodurch seine Maschine den Namen „rechnende Uhr“ erhielt. Praktisch angewendet wurde die Maschine von

Johannes Kepler bei seinen astronomischen Berechnungen.

Mechanischer Rechner von 1914

Der

Rechenschieber, eine der wichtigsten mechanischen Rechenhilfen für die Multiplikation und Division

Mechanische Rechner wie die darauf folgenden

Addierer, der

Comptometer, der

Monroe-Kalkulator, die

Curta und der

Addo-X wurden bis in die 1970er Jahre genutzt. Anders als Leibniz nutzten die meisten Rechner das

Dezimalsystem, das technisch schwieriger umzusetzen war. Dies galt sowohl für die Rechner von

Charles Babbage um 1800 wie auch für den

ENIAC von 1945, den ersten vollelektronischen Universalrechner überhaupt.

Es wurden jedoch auch nichtmechanische Rechner gebaut, wie der

Wasserintegrator.

Vom Beginn des 20. Jahrhunderts

1935 stellten

IBM die

IBM 601 vor, eine Lochkartenmaschine, die eine Multiplikation pro Sekunde durchführen konnte. Es wurden ca. 1500 Exemplare verkauft. 1937 meldete

Konrad Zuse zwei Patente an, die bereits alle Elemente der so genannten

Von-Neumann-Architektur beschreiben. Im selben Jahr baute

John Atanasoff zusammen mit dem Doktoranden Clifford Berry einen der ersten Digitalrechner, den

Atanasoff-Berry-Computer und

Alan Turing publizierte einen Artikel, der die Turing-Maschine, ein abstraktes Modell zur Definition des Algorithmusbegriffs, beschreibt.

1938 stellte Konrad Zuse die

Zuse Z1 fertig, einen frei programmierbaren mechanischen Rechner, der allerdings aufgrund von Problemen mit der Fertigungspräzision nie voll funktionstüchtig war. Die Z1 verfügte bereits über Gleitkommarechnung. Sie wurde im Krieg zerstört und später nach Originalplänen neu gefertigt, die Teile wurden auf modernen Fräs- und Drehbänken hergestellt. Dieser Nachbau der Z1, welcher im

Deutschen Technikmuseum in Berlin steht, ist mechanisch voll funktionsfähig und hat eine Rechengeschwindigkeit von 1

Hz, vollzieht also eine Rechenoperation pro Sekunde. Ebenfalls 1938 publizierte

Claude Shannon einen Artikel darüber, wie man symbolische Logik mit

Relais implementieren kann. (

Lit.: Shannon 1938)

Während des

Zweiten Weltkrieges gab Alan Turing die entscheidenden Hinweise zur Entschlüsselung der

ENIGMA-Codes und baute dafür einen speziellen mechanischen Rechner,

Turing-Bombe genannt.

Entwicklung des modernen Computers als Digitalrechner

Bis zum Ende des Zweiten Weltkrieges

Ebenfalls im Krieg (1941) baute Konrad Zuse die erste funktionstüchtige programmgesteuerte binäre Rechenmaschine, bestehend aus einer großen Zahl von Relais, die

Zuse Z3. Die Z3 war

turingmächtig und damit außerdem die erste Maschine, die – im Rahmen des verfügbaren Speicherplatzes – beliebige Algorithmen automatisch ausführen konnte. Aufgrund dieser Eigenschaften wird sie oft als erster funktionsfähiger Computer der Geschichte betrachtet. Die nächsten Digitalrechner waren der in den USA gebaute

Atanasoff-Berry-Computer (Inbetriebnahme 1941) und die britische

Colossus (1941). Sie dienten speziellen Aufgaben und waren nicht turingmächtig. Auch Maschinen auf analoger Basis wurden entwickelt.

Eigenschaften der ersten fünf Rechner

| Modell | Land | Inbetriebnahme | Binär | Elektronisch | Programmierbar | Turingmächtig |

| Zuse Z3 | Deutschland | Mai 1941 | Ja | Nein | Ja, durch Lochstreifen | Ja |

| Atanasoff-Berry-Computer | USA | Sommer 1941 | Ja | Ja | Nein | Nein |

| Colossus | UK | 1943 | Ja | Ja | Teilweise, durch Neuverkabelung | Nein |

| Mark I | USA | 1944 | Nein | Nein | Ja, durch Lochstreifen | Ja |

| ENIAC | USA | 1944 | Nein | Ja | Teilweise, durch Neuverkabelung | Ja |

| 1948 | Nein | Ja | Ja, durch eine Matrix aus Widerständen | Ja |

Nachkriegszeit

Röhrenrechner Ural-1 aus der Sowjetunion

1949 stellte

Edmund C. Berkeley, Begründer der

ACM, mit „

Simon“ den ersten digitalen, programmierbaren Computer für den Heimgebrauch vor. Er bestand aus 50 Relais und wurde in Gestalt von Bauplänen vertrieben, von denen in den ersten zehn Jahren ihrer Verfügbarkeit über 400 Exemplare verkauft wurden. Im selben Jahr stellte

Maurice Wilkes mit seinem Team in Cambridge den

Electronic Delay Storage Automatic Calculator (EDSAC) vor; basierend auf

John von Neumanns EDVAC ist es der erste Rechner, der vollständig speicherprogrammierbar war. Ebenfalls 1949 stellte

Steve Kolberg die

Zuse Z4 fertig, deren Bau schon 1942 begonnen wurde und 1944 in wesentlichen Teilen abgeschlossen war, aber kriegsbedingt nicht fertiggestellt werden konnte. 1950 wurde die

Z4 von der Firma

Zuse KG an die

ETH Zürich geliefert und ging dort in Betrieb.

In den 1950er Jahren setzte die Produktion kommerzieller (Serien-)Computer ein. Unter der Leitung von Prof.

Alwin Walther wurde am Institut für Praktische Mathematik (IPM) der TH Darmstadt ab 1951 der DERA (Darmstädter Elektronischer Rechenautomat) erbaut.

Remington Rand baute 1951 ihren ersten kommerziellen Röhrenrechner, den

UNIVersal Automatic Computer I (UNIVAC I) und 1955

Bell Labs für die

US Air Force mit dem

TRansistorized Airborne DIgital Computer (TRADIC) den ersten Computer, der komplett mit Transistoren statt

Röhren bestückt war; im gleichen Jahr begann

Heinz Zemanek mit der Konstruktion des ersten auf europäischem Festland gebauten Transistorrechners, dem

Mailüfterl. Ebenfalls im gleichen Jahr baute die

DDR mit der „

OPtik-REchen-MAschine“ (OPREMA) ihren ersten Computer. 1956 fertigte IBM das

erste Magnetplattensystem (Random Access Method of Accounting and Control (RAMAC)). Ab 1958 wurde die

Electrologica X1 als volltransistorisierter Serienrechner gebaut. Noch im selben Jahr stellte die Polnische Akademie der Wissenschaften in Zusammenarbeit mit dem Laboratorium für mathematische Apparate unter der Leitung von Romuald Marczynski den ersten polnischen Digital Computer „XYZ“ vor. Vorgesehenes Einsatzgebiet war die Nuklearforschung. 1959 begann

Siemens mit der Auslieferung des

Siemens 2002, des ersten in Serie gefertigten und vollständig auf Basis von Transistoren hergestellten Computers.

1960er

1960 baute IBM den

IBM 1401, einen transistorisierten Rechner mit Magnetbandsystem, und

DECs (Digital Equipment Corporation) erster

Minicomputer, die

PDP-1 (Programmierbarer Datenprozessor) erscheint. 1962 lieferte die

Telefunken AG die ersten

TR 4 aus. 1964 baute DEC den Minicomputer

PDP-8 für unter 20.000 Dollar.

1964 definierte IBM die erste Computerarchitektur

S/360, womit Rechner verschiedener Leistungsklassen denselben Code ausführen können und bei

Texas Instruments wird der erste „

integrierte Schaltkreis“ (IC) entwickelt. 1965 stellte das Moskauer Institut für Präzisionsmechanik und Computertechnologie unter der Leitung seines Chefentwicklers Sergej Lebedjew mit dem

BESM-6 den ersten exportfähigen Großcomputer der

UdSSR vor. BESM-6 wurde ab 1967 mit

Betriebssystem und Compiler ausgeliefert und bis 1987 gebaut. 1966 erschien dann auch noch mit

D4a ein 33bit Auftischrechner der

TU Dresden.

1968 bewarb

Hewlett-Packard (HP) den

HP-9100A in der Science-Ausgabe vom 4. Oktober 1968 als „personal computer“. Die 1968 entstandene

Nixdorf Computer AG erschloss zunächst in Deutschland und Europa, später auch in Nordamerika, einen neuen Computermarkt: die

Mittlere Datentechnik bzw. die dezentrale

elektronische Datenverarbeitung. Massenhersteller wie

IBM setzten weiterhin auf Großrechner und zentralisierte Datenverarbeitung, wobei Großrechner für

kleine und mittlere Unternehmen schlicht zu teuer waren und die Großhersteller den Markt der Mittleren Datentechnik nicht bedienen konnten. Nixdorf stieß in diese Marktnische mit dem modular aufgebauten

Nixdorf 820 vor, brachte dadurch den Computer direkt an den Arbeitsplatz und ermöglichte kleinen und mittleren Betrieben die Nutzung der elektronischen Datenverarbeitung zu einem erschwinglichen Preis. Im Dezember 1968 stellten

Douglas C. Engelbart und

William English vom

Stanford Research Institute (SRI) die erste

Computermaus vor, mangels sinnvoller Einsatzmöglichkeit (es gab noch keine grafischen Benutzeroberflächen) interessierte dies jedoch kaum jemanden.

1970er

Mit der Erfindung des serienmäßig produzierbaren

Mikroprozessors wurden die Computer immer kleiner und leistungsfähiger. Doch noch wurde das Potential der Computer verkannt. So sagte noch 1977

Ken Olson, Präsident und Gründer von DEC: „Es gibt keinen Grund, warum jemand einen Computer zu Hause haben wollte.“

1975

Maestro I (ursprünglich Programm-Entwicklungs-Terminal-System PET) von

Softlab war weltweit die erste

Integrierte Entwicklungsumgebung für Software.

Maestro I wurde weltweit 22.000-mal installiert, davon 6.000-mal in der Bundesrepublik Deutschland. Maestro I war in den 70er und 80er Jahren führend auf diesem Gebiet.

1980er

C64 mit 5¼″-Diskette und Laufwerk

1990er

Entwicklung im 21. Jahrhundert

Zu Beginn des 21. Jahrhunderts sind Computer sowohl in beruflichen wie privaten Bereichen allgegenwärtig und allgemein akzeptiert. Während die Leistungsfähigkeit in klassischen Anwendungsbereichen weiter gesteigert wird, werden digitale Rechner unter anderem in die

Telekommunikation und

Bildbearbeitung integriert. 2001 baute IBM den Supercomputer

ASCI White und 2002 ging der

NEC Earth Simulator in Betrieb. 2003 lieferte Apple den PowerMac

G5 aus, den ersten Computer mit 64-Bit-Prozessoren für den Massenmarkt. AMD zog mit dem

Opteron und dem

Athlon 64 nach. 2005 produzierten AMD und Intel erste

Dual-Core-Prozessoren, 2006 doppelte Intel mit den ersten

Core 2 Quad-Prozessoren nach. Seit Ende 2008 gibt es von Intel auch die

Core-i CPUs, die sich jedoch trotz insgesamt teuerer Plattform (Mainboard, DDR3-RAM, CPU) leistungsmäßig kaum vor die

Core 2 Quad-Reihe setzen kann. In puncto Multimedia (Enkodierung &c.) kommt ihr jedoch die

Hyperthreading-Technologie zugute, die ihr die gleichzeitige Ausführung von bis zu 8

Threads ermöglicht.

Zukunftsperspektiven

Zukünftige Entwicklungen bestehen aus der möglichen Nutzung biologischer Systeme (

Biocomputer), optischer Signalverarbeitung und neuen physikalischen Modellen (

Quantencomputer). Weitere Verknüpfungen zwischen biologischer und technischer Informationsverarbeitung. Auf der anderen Seite nimmt man langsam Abstand von nicht realisierten Trends der letzten 20 Jahre,

Expertensysteme und

Künstliche Intelligenzen, die ein Bewusstsein entwickeln, sich selbst verbessern oder gar rekonstruieren, zu erforschen.

Zeitleiste

Siehe auch

Quellenangaben

- ↑ http://www.heise.de/tp/deutsch/inhalt/co/18371/1.html

Literatur

Geschichte

- Berkeley, Edmund Callis: Giant Brains or Machines That Think, New York: John Wiley & Sons 1949 (7. Aufl. 1963) – die erste populäre Darstellung der EDV, trotz des für moderne Ohren seltsam klingenden Titels sehr seriös und fundiert – relativ einfach antiquarisch und in fast allen Bibliotheken zu finden

- Bowden, B. V. (Hg.): Faster Than Thought, New York: Pitman 1953 (Nachdruck 1963) – eine frühe populäre Darstellung der EDV, gibt den Stand seiner Zeit verständlich und ausführlich wieder; nur mehr antiquarisch und in Bibliotheken zu finden, ISBN 0-273-31580-3

- Friedewald, Michael, Der Computer als Werkzeug und Medium. Die geistigen und technischen Wurzeln des Personalcomputers, GNT-Verlag 2000, ISBN 3928186477 – hervorragende Studie

- Head, Simon, The New Ruthless Economy. Work and Power in the Digital Age, Oxford UP 2005, ISBN 0-19-517983-8 - der Einsatz des Computers in der Tradition des Taylorismus

- Hoffmann, Ute, Computerfrauen. Welchen Anteil hatten Frauen an der Computergeschichte und -arbeit?, München 1987

- N.N.: Loading History. Computergeschichte(n) aus der Schweiz, Bern: Museum für Kommunikation 2001 ISBN 3-0340-0540-7 – Ausstellungskatalog zu einer Sonderausstellung mit Schweizer Schwerpunkt, aber für sich alleine lesbar

- N.N.: HNF Heinz Nixdorf Forum Museumsführer, Paderborn: HNF 2000 ISBN 3-9805757-2-1 – Museumsführer des nach eigener Darstellung weltgrößten Computermuseums

- Weinhart, Karl: Informatik und Automatik. Führer durch die Ausstellungen, München: Deutsches Museum 1990 ISBN 3-924183-14-7 – der Katalog zu den permanenten Ausstellungen des Deutschen Museums zum Thema; vor allem als ergänzende Literatur zum Ausstellungsbesuch empfohlen

- Wurster, Christian: Computers. Eine illustrierte Geschichte, Taschen 2002 ISBN 3-8228-5729-7 – eine vom Text her leider nicht sehr exakte Geschichte der EDV mit einzelnen Fehlern, die aber durch die Gastbeiträge einzelner Persönlichkeiten der Computergeschichte und durch die zahlreichen Fotos ihren Wert hat

- Reifenrath, Andre: Geschichte der Simulation, Humboldt Universität, Dissertation, Berlin 2000. Geschichte des Computers von den Anfängen bis zur Gegenwart unter besonderer Berücksichtigung des Themas der Visualisierung und Simulation durch den Computer. Als PDF zu finden auf PEO Suchwort Engelbart eingeben oder direkt als PDF